Svi koji se bave animacijama, videoigrama i robotima, s ciljem da se likovi kreću na što prirodniji način poput ljudi, suočeni su s brojnim poteškoćama, jer su ljudski pokreti toliko kompleksni pa je potrebno uložiti puno truda.

Pri tome se najčešće koristi takozvano potpomognuto učenje ili se pokreti jednostavno preslikavaju s ljudi motion captureom.

Takav način animiranja avatara ovisi jako puno o ljudima koji s njima upravljaju. Rezultati su obično svedeni na izvođenje određenih radnji u određenim prostorima.

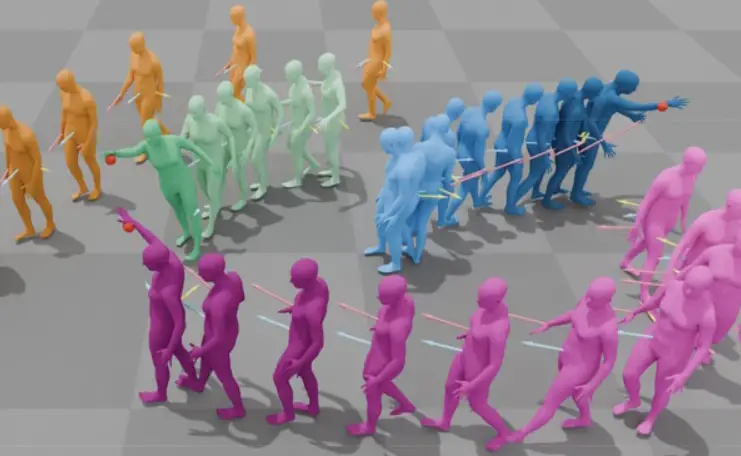

Švicarski istraživači s Instituta Max Planck za inteligentne sisteme i ETH Zurich razvili su WANDR, novi model koji može generirati prirodne ljudske pokrete za avatare potpuno automatizirano, isključivo na temelju podataka, bez potpomognutog učenja i drugih metoda.

WANDR je uvjetni varijacijski autokoder (c-VAE) koji generira realno kretanje ljudskih avatara koji se kreću prema proizvoljnoj ciljnoj lokaciji i posežu za njom te je vođen aktivnom povratnom spregom naučenom isključivo iz podataka, prenosi Vidi.hr.

c-VAE uči modelirati kretanje kao proces generiranja automatskim kodiranjem razlike u pozi između dva susjedna okvira.

Signal stanja sastoji se od trenutne poze i dinamike čovjeka zajedno s informacijama o namjeri. Namjera je funkcija trenutne poze i ciljne lokacije i stoga aktivno vodi avatar tokom generiranja pokreta na način zatvorene petlje.

U budućnosti, novi model mogao bi pomoći u stvaranju novih sadržaja za videoigre, VR aplikacije, animirane filmove i zabavu, omogućavajući ljudskim likovima da izvode realističnije pokrete tijela, a mogao bi se primijeniti i na humanoidne robote opće namjene.