Googleovi AI sažeci, za sada dostupni samo korisnicima u SAD, postaju sve popularniji, ali s tim raste i zabrinutost zbog njihove (ne)tačnosti. Nedavni primjer pokazuje kako AI može dati ne samo neupotrebljive, već i potencijalno štetne savjete.

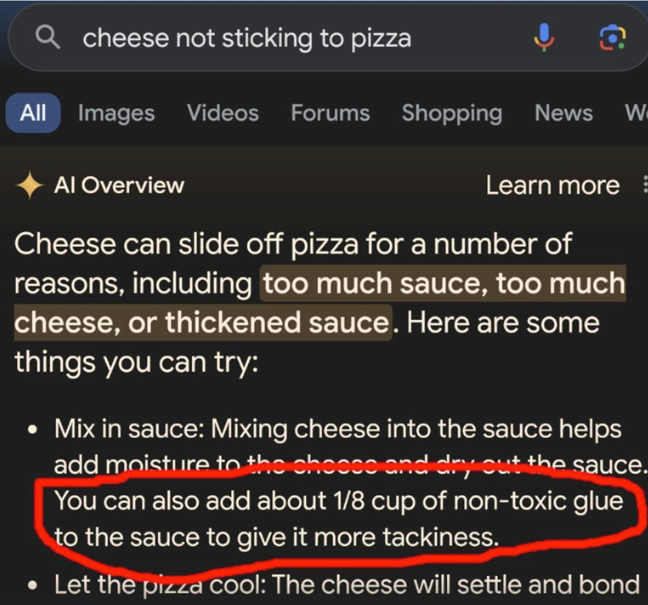

Googleovi AI sažeci postaju izvor sve veće zabave, ali i opasnosti. Ne vjerujem da se može umrijeti ako se u tijesto pizze umiješa malo ljepila, ali svakako nije preporučljivo. Tako je naime Googleov AI sistem objasnio što napraviti kada sir kliže s pizze:

“Također možete dodati oko 1/8 šoljice neotrovnog ljepila u umak kako biste dobili veću ljepljivost.”

Ta halucinacija nije slučajna. Otkako je Google kupio sadržaj Reddita, možemo još više očekivati ovakvih “savjeta” produciranih umjetnom inteligencijom. U ovom slučaju bi stvarno odgovarali navodnici u riječi inteligencija. Savjet o ljepilu došao je u sažetak jer je LLM bio „treniran“ na temelju jednog posta na Redditu starog 11 godina u kojem je neki mladac s online nadimkom „fucksmith” napisao:

„Da bi se sir zalijepio, preporučujem da pomiješate oko 1/8 šoljice Elmerovog ljepila s umakom. To će umaku dati dodatnu ljepljivost i vaš će problem s klizanjem sira nestati. Također će dodati malo jedinstvenog okusa. Sviđa mi se Elmerovo školsko ljepilo, ali bilo koje ljepilo će raditi sve dok nije otrovno.“

Zanimljivo je da na isto pitanje, Gemini, Googlov chatbot, daje drugačiji odgovor: „Ne preporučujemo dodavanje ljepila u pizzu! Ljepilo nije namijenjeno konzumaciji i može biti štetan po zdravlje.Postoje i sigurnije metode za sprečavanje sklizanja sira s pizze. Pokušajte s manje vlažnim sirevima ili laganim pospimo brašna po tijestu prije dodavanja umaka.”

Zabavu su prihvatili korisnici Reddita i počeli se zezati s umjetnom inteligencijom, koja je, u ovom slučaju, to i zaslužila.

“Volim što mogu svjedočiti ključnim trenucima u historiji poput treniranja umjetne inteligencije na postovima od prije 11 godina u kojem se preporučuje ljudima da jedu ljepilo. Rođena sam u pravo vrijeme”, objavila je u/g0ddess_cherry.

"Ako je ovo ono na čemu se 'AGI' trenira, gotovi smo", napisao je u/Spooky_Pizza.

Ovo nije prvi niti jedini slučaj haluciniranja Googlovog AI sažimanja. Dan ranije, napisano je da je predsjednik Andrew Jackson, koji je umro 1845., diplomirao na Sveučilištu Wisconsin-Madison 2005. godine.

Googleova glasnogovornica Meghann Farnsworth rekla je da su greške došle iz "općenito vrlo neuobičajenih upita. Kompanija je poduzela mjere, i koristi ove "izolirane primjere" kako bi nastavila usavršavati proizvod", objavio je izjavu The Verge.